Unitree G1を動かすハッカソンに参加してきました!

2024年に中国Unitree Robotics社が発表した、約1万6000ドル(約250万円)の最新ヒューマノイドロボットに触れる貴重な機会でした。

以下、体験記です。

https://robotmatehub-hack01.peatix.com/

どんなハッカソン?Unitree G1とは。

🎉 日本初※のUnitree G1ハッカソン!

※主催者調べPhysical AIが注目される今、本ハッカソンは Unitree社の最新ヒューマノイドロボット「G1」を使用し、

「人とロボットの共生社会」をテーマにアイデアを形にする2日間のイベントです。エンジニアだけでなく、デザイナー、プランナー、学生、研究者など

多様なバックグラウンドを持つ方々が混成チームを組み、

「こんなロボットと暮らしたい」という未来を一緒にデザインします。✨ 実機を使った開発体験

✨ 一流審査員からのフィードバック

✨ 各賞の授与

✨ 同じ志を持つ仲間との出会い

✨ 全員に修了証を発行予定!(ポートフォリオ・就活にも活用可)

ということで、Unitree G1が触れることが大きな特徴のハッカソンでした。

何がどこまで出来るか知りたい方は、2026年2月に開催されたカンフーパフォーマンスの動画を見るのがおすすめです。

この速度感で滑らかに動いているもの凄いですし、特に複数台協調して自律動作しているらしく衝撃でした。

公式サイト+日本代理店は以下みたいです。

参加経緯

過去一緒にハッカソンに参加した友人がSlackで共有してくれて知り、

- お家(比較的)近い

- 250万円のヒューマノイドロボットを実際に触れる!

- 大学/大学院時代にロボティクスを専攻していて、もともと分野に関心あり

- ロボコンも少し出ていた

- 会社でヒューマノイドロボット部門が出来たこともあり、何か持ち帰れるものがないかキャッチアップしたい

- エッジAI/組み込みシステムのエンジニアとしてお仕事しており、どこかで繋がりそう

- 界隈の知り合いに会えそう

といった背景あり参加しました。

スケジュール

1日目

19:00~22:00にオンラインで集まり、環境構築/チームビルディング/アイディア検討を行いました。

以下のPythonSDKをWSL(Ubuntu)上に構築しました。

シミュレータの方はインストールしたけど、起動後すぐ落ちる(?)問題が発生しました。

2日目

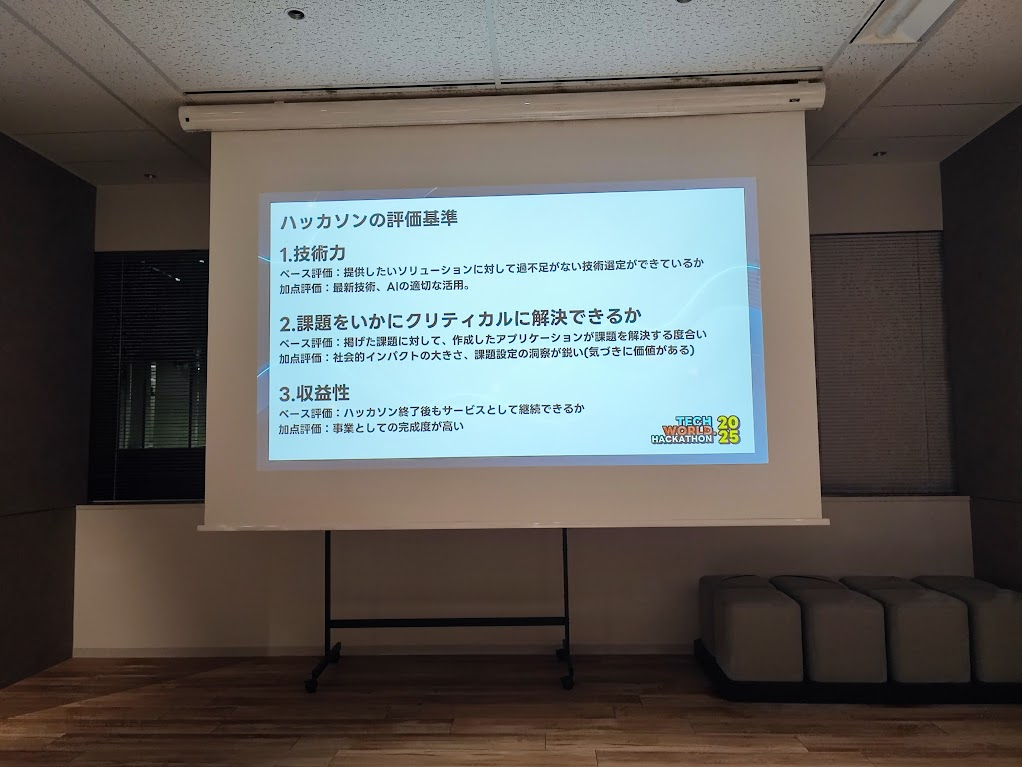

藤沢のロボット企業交流リンクに集まり、実機を使ったハッカソンを行いました。

|

09:30〜10:00 |

受付・会場案内 |

|

10:00〜10:30 |

開会式・ロボリンク紹介・審査員紹介 |

|

10:30〜11:00 |

シーンカードワークショップ |

|

11:00〜12:00 |

開発セッション1(実機ローテーション) |

|

12:00〜12:30 |

中間チェック・PMO巡回 |

|

12:30〜13:45 |

ランチセッション・ネットワーキング |

|

13:45〜15:00 |

開発セッション2(実機ローテーション) |

|

15:00〜15:30 |

中間発表会 |

|

15:30〜16:00 |

プレゼン準備 |

|

16:00〜17:15 |

ローテーション発表(実機デモ+プレゼン) |

|

17:15〜17:30 |

Audience Choice投票・審査 |

|

17:30〜18:00 |

表彰式 |

|

18:00〜18:30 |

記念撮影・クロージング |

|

18:45〜19:45 |

懇親会(任意参加) |

やったこと/開発したもの

スライド、Githubは以下になります。

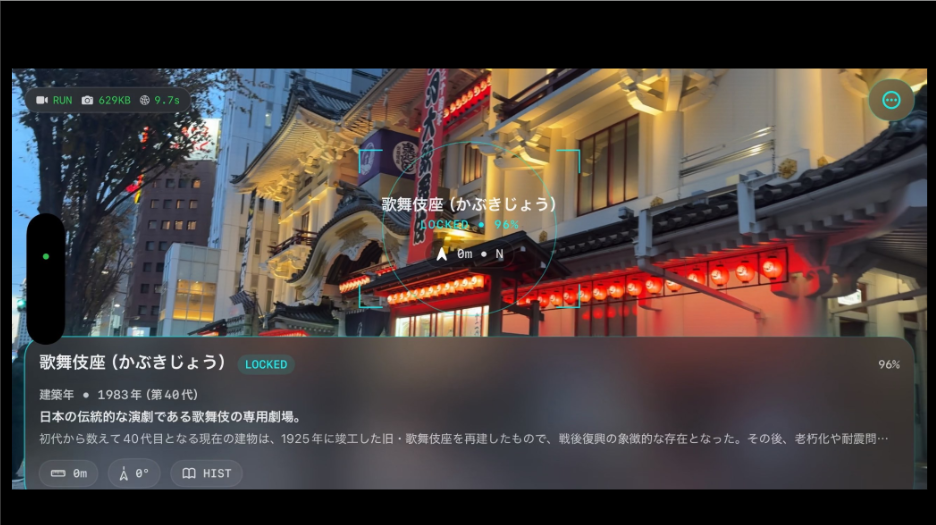

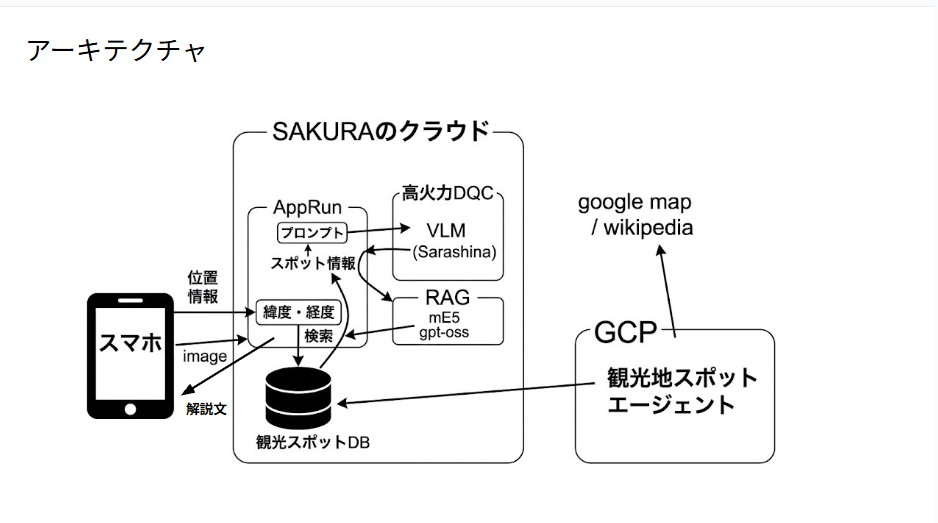

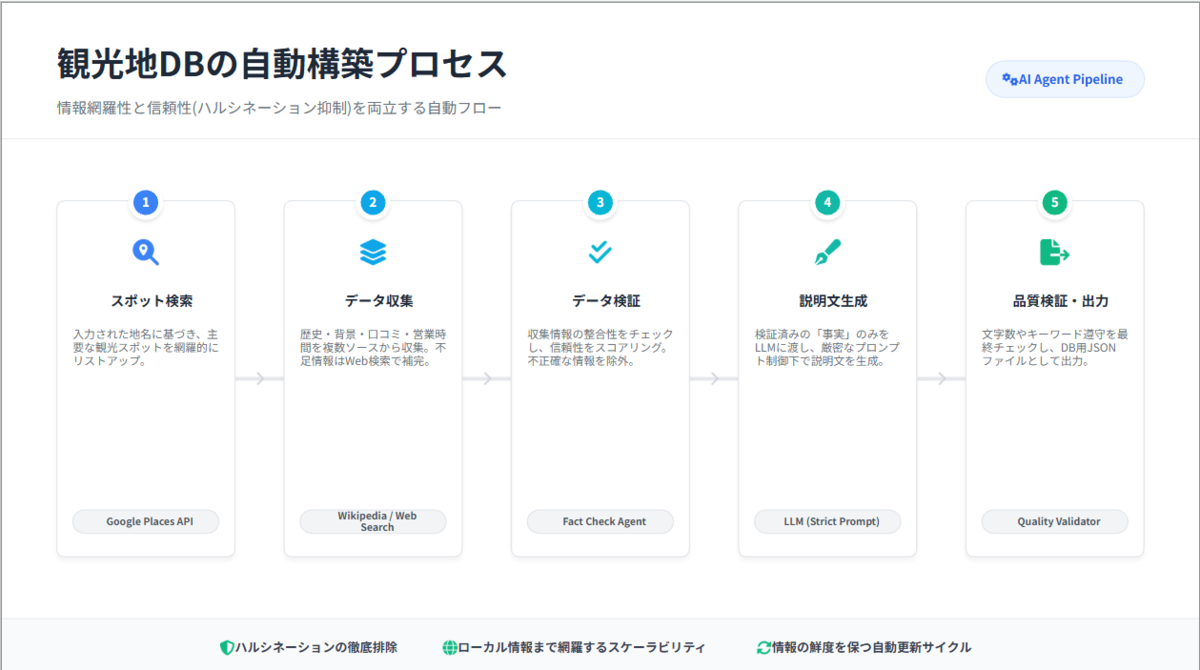

スライドにのっていない実機デモとして

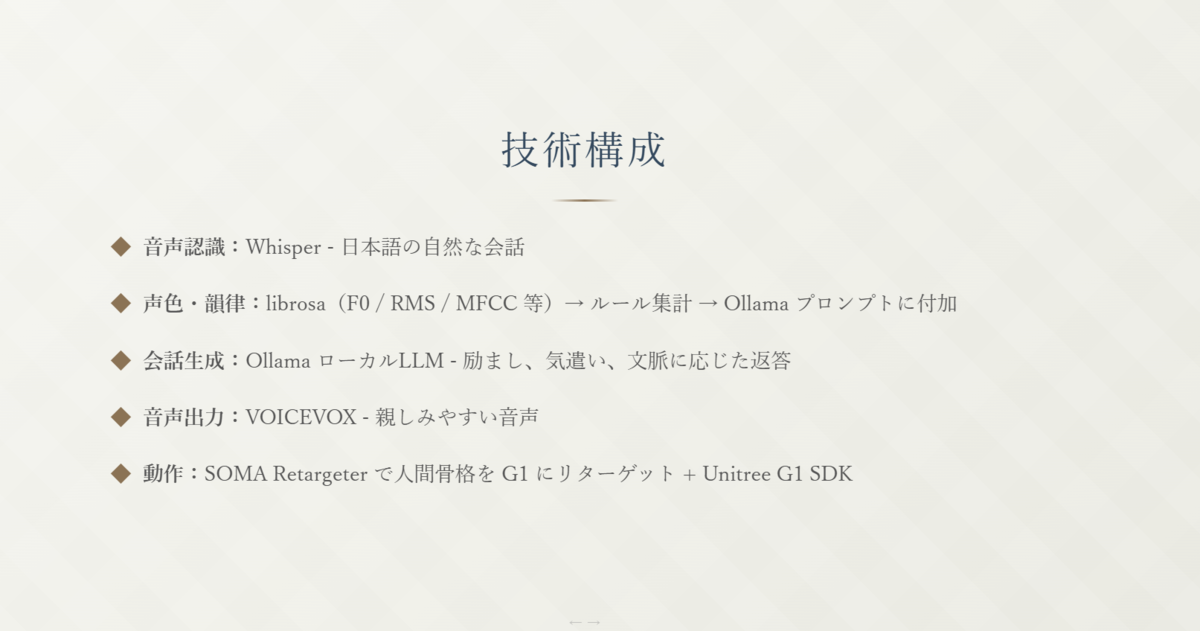

- ローカルで感情認識+音声デモ(librosa+Ollama+Whisper+VOICEBOX)

- Unitree g1で一本締めモーション(Text2Speachで音声+Clap拍手の動作)

を行いました。

今回は4人チームで、自分はロボット操作/モーション作成の担当をしました。

(早めにUnitree G1 SDKのセットアップを終えてSDKのコードを読めていた、

事前検討としてモーション作成について調べていたことで担当させてもらいました。

デモまでは出来なかったのですが、特に得だしでアピールしたいのは

人のモーション動画→Unitree g1を動かすモーション(csv)生成、シミュレーション動画生成するJupyterNotebookの開発(Colaboratoryで皆が手元で動かせるようにした)

という点です。

もともと「ハレ晴レユカイ」をUnitree G1と一緒に踊ってバズらせたいと思っていたのですが、シミュレーションと実機動作に乖離あり、危険ということで断念しました。

シミュレーション

現実

技術的な内容は以下を参考にしました。

(単に骨格推定するだけでなく、逆運動学的な制約も加味した出力にする、というのが素晴らしいライブラリでした。Nvidiaすごい。

YouTube踊ってみた動画(mp4)

↓ GEM-X(単眼動画 → SOMA 77関節の3Dポーズ推定)

SOMA スケルトン形式のモーションデータ(BVH)

↓ SOMA Retargeter(Newton + Warpで物理的に正しいIK変換)

Unitree G1 の関節データ(CSV, 29DOF)

↓ unitree_rl_gym(強化学習で物理的に実行可能に)

G1が実際にダンス

感想

久しぶりに実機ロボットを触れて楽しかったですが、「百聞は一見に如かず」の言葉通りでロボット開発の難しさを改めて感じました。

今回かなり実機操作に苦戦しており、

- プレゼン1時間前までUnitree G1にコマンド送信が出来なかった

- 他チームの方にFirewallを切ったらいけたと教えてもらい、解決

- 手順書にもない内容でした、、

- 他チームの方にFirewallを切ったらいけたと教えてもらい、解決

- 当日使えるUnitree G1が古い/一部故障している/動作制約があるなどの理由で、想定していた動作が出来なかった

- 3チームで1台のUnitree G1を使う状態で、実機を触れたのが1時間弱だった

という制約の中でのプレゼンとなり、悔しい気持ちもあります。

(実はUnitreeを操作できるアプリあり、これを使っていたチームもあったみたいです

昨今Physical AIが叫ばれていますが、今この時代に、トップニュースだけでなく実機の限界点や問題点を理解できたのは凄く良い経験でした。社会実装には熱や充電、使いまわし、UIなど様々な課題があることもわかりました。

また、同時に中華メーカーの開発力、Nvidiaのエコシステム構築力の凄さも実感できました。自分たちが何をするべきか考える必要を感じました。

実機を触る楽しい所を担当させてくれたチームには大変感謝です。

懇談会もロボットに情熱を持つ方々が集まっていたためか、次の可能性が広がるような会話が繰り広げられていて、とても楽しかったです。

どこかでハレ晴レユカイ踊れるようにしたいなあ。

Unitree g1ハッカソン楽しかった!

— aki310 (@fox_aki310ooooo) 2026年3月28日

苦戦したけど良い経験でした🤖

(左)simulationで動かしたハレ晴レユカイ

(右)実機で動かしてみた

※タイムチャート制御など出来ておらず、危なかったやらかし pic.twitter.com/AmNF3zPLFn

人の骨格推定(動画)→unitree g1の制御モーション(csv)とシミュレーション動画を出力するcolaboratoryコードを作りました。

— aki310 (@fox_aki310ooooo) 2026年3月28日

(精度とか未完成なので、どなたかぜひ完成させて下さい🙏🙏https://t.co/exS4jpkj5e